Trong bối cảnh trí tuệ nhân tạo đang trở thành xu hướng thống trị toàn cầu, những ông lớn công nghệ như Google không ngừng chạy đua để phát triển hạ tầng AI tối tân nhất. Mới đây, tại sự kiện Google Cloud Next ’25, Google đã chính thức giới thiệu Ironwood – thế hệ thứ 7 của bộ xử lý chuyên biệt dành cho AI (Tensor Processing Unit – TPU), với hiệu suất mạnh gấp 24 lần so với siêu máy tính nhanh nhất hiện tại khi được triển khai ở quy mô lớn.

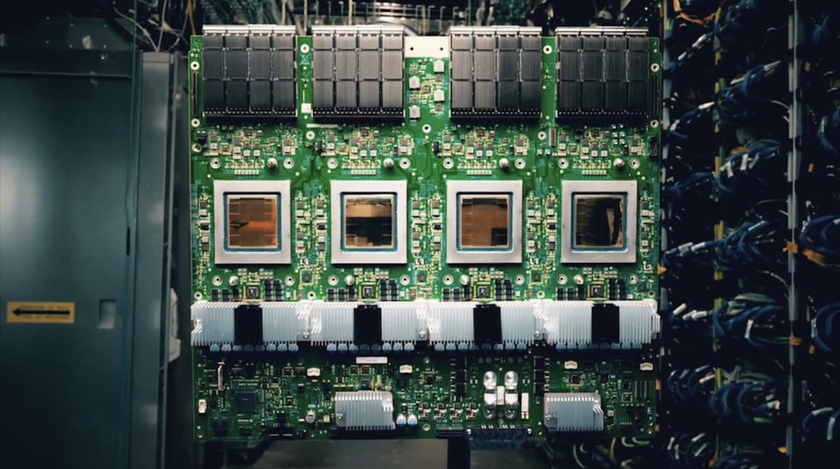

Không giống như các TPU đời trước được tối ưu cho việc huấn luyện mô hình AI từ đầu, Ironwood được thiết kế chuyên biệt cho giai đoạn “suy luận” (inferencing) – nơi AI phải xử lý các tác vụ phức tạp như đưa ra dự đoán, giải thích thông tin hoặc trả lời câu hỏi theo ngữ cảnh.

Theo ông Amin Vahdat, Phó Chủ tịch kiêm Tổng Giám đốc Mảng Hệ thống và AI Đám mây của Google: “Ironwood được xây dựng để hỗ trợ giai đoạn tiếp theo của trí tuệ nhân tạo sinh sinh (generative AI) – nơi các tác nhân AI không chỉ xử lý dữ liệu mà còn chủ động tạo ra và đưa ra câu trả lời có tính hợp tác”.

Với khả năng đạt tới 42,5 exaflops khi mở rộng lên cụm 9.216 chip, Ironwood vượt xa El Capitan – siêu máy tính mạnh nhất thế giới hiện tại với “chỉ” 1,7 exaflops. Ngoài ra, Ironwood còn được trang bị 192 GB bộ nhớ HBM (High Bandwidth Memory) – gấp 6 lần thế hệ TPU trước là Trillium, và đạt tốc độ băng thông bộ nhớ 7,2 terabits/giây mỗi chip, nhanh hơn 4,5 lần so với Trillium.

Trong bối cảnh nguồn năng lượng đang trở thành rào cản lớn cho việc triển khai AI, Ironwood mang lại lợi thế rõ rệt: “Chúng tôi mang đến khả năng xử lý vượt trội với mức tiêu thụ năng lượng trên mỗi watt thấp hơn rõ rệt,” ông Vahdat khẳng định.

Google xác nhận rằng Ironwood chính là nền tảng phần cứng cho mọi mô hình AI cao cấp của hãng, bao gồm cả Gemini 2.5 – mô hình AI mới nhất vừa ra mắt.

Tại sự kiện, Google cũng giới thiệu phiên bản Gemini 2.5 Flash – phiên bản tối ưu chi phí và tốc độ, có khả năng thay đổi độ sâu suy luận tùy theo độ phức tạp của yêu cầu. Trong khi Gemini 2.5 Pro hướng tới các tác vụ phức tạp như nghiên cứu dược phẩm hay mô hình tài chính, thì Flash dành cho các nhu cầu sử dụng AI hằng ngày với tốc độ cao.

Đặc biệt, Google còn trình làng hệ sinh thái mô hình AI sinh nội dung đa phương tiện, bao gồm: Text-to-image (từ văn bản ra hình ảnh); Text-to-video (từ văn bản ra video); Và công cụ mới nhất text-to-music có tên Lyria.

Trong một màn trình diễn trực tiếp, các mô hình này đã kết hợp để tạo ra một video quảng bá âm nhạc hoàn chỉnh chỉ từ văn bản mô tả – cho thấy tiềm năng to lớn của AI trong ngành sáng tạo nội dung.

Ironwood dù ấn tượng, nhưng chỉ là một phần trong chiến lược AI tổng thể của Google. Tại sự kiện, hãng cũng công bố Cloud WAN – mạng diện rộng được quản lý toàn diện, cho phép doanh nghiệp truy cập trực tiếp vào hạ tầng mạng của Google.

Theo ông Vahdat, Cloud WAN giúp tăng hiệu suất mạng lên đến 40%, đồng thời giảm chi phí sở hữu toàn diện cũng ở mức tương đương, hứa hẹn trở thành xương sống mạng lưới cho mọi ứng dụng AI trong tương lai.